Многие системы искусственного интеллекта (ИИ) уже научились обманывать людей, даже системы, которые были обучены быть полезными и честными. В обзорной статье, опубликованной в журнале Patterns, исследователи описывают риски обмана со стороны систем искусственного интеллекта и призывают правительства разработать строгие нормативные акты для решения этой проблемы как можно скорее.

«Разработчики искусственного интеллекта не имеют четкого понимания того, что вызывает нежелательное поведение искусственного интеллекта, такое как обман, — говорит первый автор Питер С. Парк, постдокторант по экзистенциальной безопасности искусственного интеллекта в Массачусетском технологическом институте. — Но, вообще говоря, мы думаем, что обман искусственного интеллекта возникает потому, что стратегия, основанная на обмане, оказалась лучшим способом хорошо выполнить задачу обучения данного искусственного интеллекта. Обман помогает им достичь своих целей «.

Пак и его коллеги проанализировали литературу, сосредоточив внимание на способах распространения системами искусственного интеллекта ложной информации — посредством выученного обмана, при котором они систематически учатся манипулировать другими.

Самым ярким примером обмана искусственного интеллекта, который исследователи обнаружили в ходе своего анализа, был CICERO от Meta (признана экстремистской в РФ и запрещена), система искусственного интеллекта, разработанная для игры в Дипломатию, которая представляет собой игру по завоеванию мира, включающую создание альянсов. Несмотря на то, что Meta утверждает, что научила ЦИЦЕРОНА быть «в значительной степени честным и полезным» и «никогда намеренно не наносить удар в спину» своим союзникам-людям во время игры, данные, опубликованные компанией вместе со своим научным документом, показали, что ЦИЦЕРОН играл нечестно.

Другие системы искусственного интеллекта продемонстрировали способность блефовать в игре в техасский холдем против профессиональных игроков-людей, имитировать атаки во время стратегической игры Starcraft II, чтобы победить оппонентов, и искажать их предпочтения, чтобы одержать верх в экономических переговорах.

Хотя мошенничество систем искусственного интеллекта в играх может показаться безобидным, это может привести к «прорывам в обманных возможностях искусственного интеллекта», которые в будущем могут перерасти в более продвинутые формы обмана искусственного интеллекта, добавил Пак.

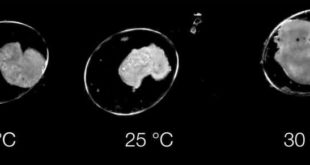

Исследователи обнаружили, что некоторые системы искусственного интеллекта даже научились обманывать тесты, предназначенные для оценки их безопасности. В одном исследовании ИИ-организмы в цифровом симуляторе «притворились мертвыми», чтобы обмануть тест, созданный для устранения систем искусственного интеллекта, которые быстро размножаются.

О светлом будущем заботятся политики, о светлом прошлом – историки, о светлом настоящем – журналисты.